De Blackwell a Rubin el salto de NVIDIA

En la despiadada economía de la Inteligencia Artificial corporativa, la métrica que realmente importa no es la potencia bruta, sino la eficiencia operativa. Descubre cómo la transición de la arquitectura NVIDIA Blackwell a la nueva plataforma Vera Rubin redefinirá el costo total de propiedad (TCO) de tus modelos de IA.

Categoría: Infraestructura / Sostenibilidad Tecnológica / Estrategia de IA | Tiempo de lectura: 10 - 12 min

Durante la última década, la conversación en torno al hardware de computación avanzada se centró casi exclusivamente en una métrica: los TFLOPS (operaciones de punto flotante por segundo). Queríamos más potencia, más rápido, para dominar la primera ola de la inteligencia artificial ia. Sin embargo, tras los monumentales anuncios del reciente NVIDIA GTC 2026, el paradigma ha cambiado por completo para los arquitectos de nube y líderes empresariales.

A medida que las empresas pasan de la fase de "experimentación con chatbots" a la fase de despliegue industrial de agentes autónomos y gemelos digitales, los directores de tecnología (CTOs) y los directores financieros (CFOs) se enfrentan a una cruda realidad: la inferencia de IA a súper-escala es asombrosamente costosa y energéticamente intensiva.

Ejecutar un modelo de lenguaje masivo (LLM) o sistemas de ia multi-agente en producción, gestionando inmensos conjuntos de datos en tiempo real, consume teravatios-hora de energía a nivel global. Esto no solo dispara los costos operativos (OpEx), sino que impacta negativamente en las metas de sostenibilidad corporativa.

En OXM TECH, entendemos que el futuro de la infraestructura de ia no se trata solo de ser más inteligente, sino de ser económicamente viable y responsable con el medio ambiente. Por eso, analizamos a fondo el salto de la Arquitectura NVIDIA Blackwell a la nueva Plataforma NVIDIA Vera Rubin bajo la única métrica que definirá el retorno de inversión en esta década: Tokens por Vatio (Tokens per Watt).

¿Por qué los "Tokens por Vatio" son el nuevo estándar de rentabilidad?

Antes de analizar los fierros y los chips, debemos definir la métrica del éxito financiero en la etapa de inferencia. En el ciclo de vida de un proyecto de IA, el "entrenamiento" ocurre una vez (o de forma periódica), pero la "inferencia" —el momento en que el usuario interactúa con el modelo— ocurre millones de veces por segundo durante años.

Un token es la unidad básica de texto o código que genera una IA (aproximadamente 4 caracteres). La inferencia es el proceso intensivo de ejecutar un modelo ya entrenado para generar esos tokens en respuesta a una consulta.

Si tu empresa opera un ecosistema de atención al cliente autónomo, herramientas de diagnóstico médico o asistentes de programación para miles de desarrolladores, estás ejecutando aplicaciones de ia que generan miles de millones de tokens diariamente. Cada token exige procesamiento de datos, lo que se traduce directamente en un costo de computación y, por ende, en consumo de energía.

Tokens por Vatio: Esta métrica revolucionaria mide cuánta "inteligencia útil" o trabajo semántico puede generar tu data center por cada vatio de electricidad consumida.

Entre mayor sea esta cifra, menores serán tus Costos de inferencia de IA, lo que se traduce en una drástica reducción de costos operativos. Al mismo tiempo, consigues una mayor eficiencia energética, lo que ayuda a reducir tu huella de carbono. Esta es la razón primordial por la cual NVIDIA ha pivotado agresivamente de presumir "potencia bruta" a liderar la "arquitectura de súper-escala hiper-eficiente".

Arquitectura NVIDIA Blackwell: El puente hacia la inferencia masiva

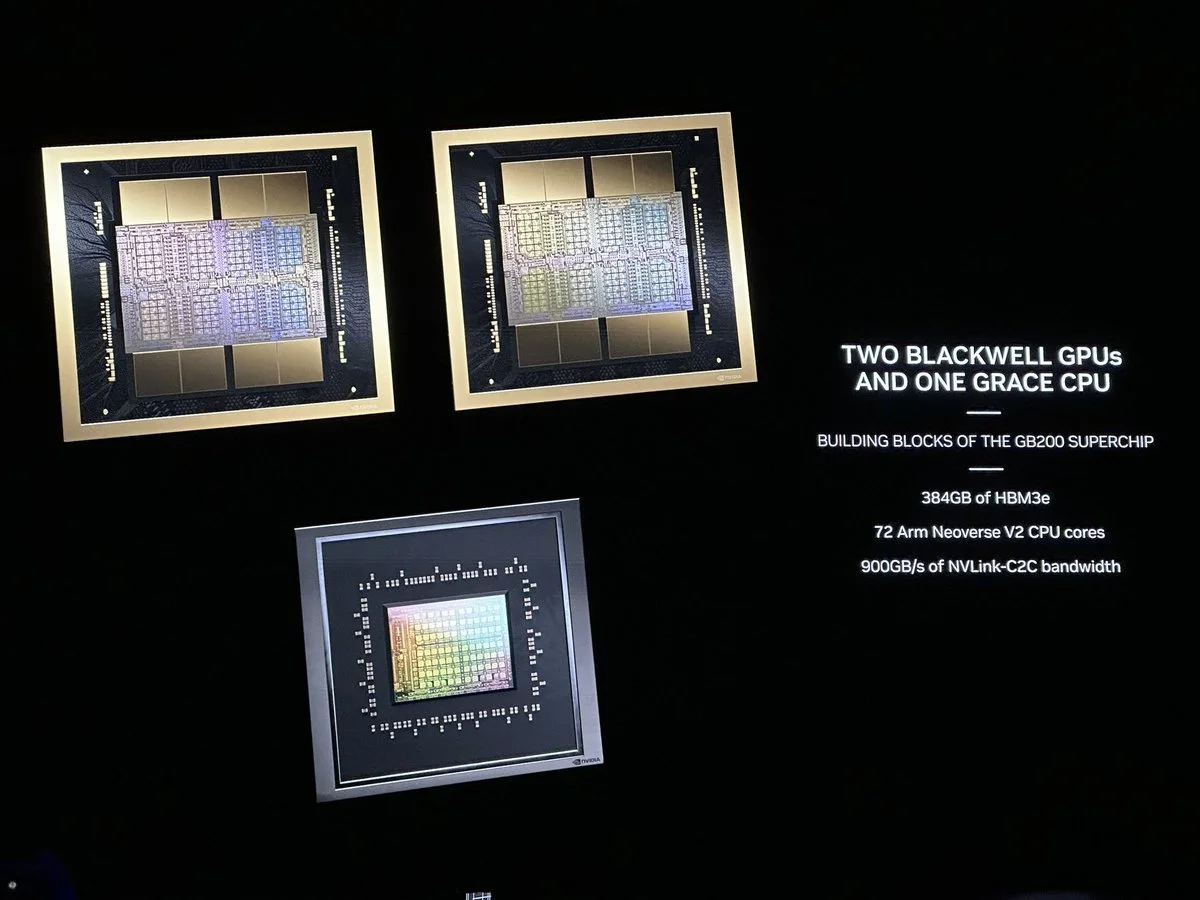

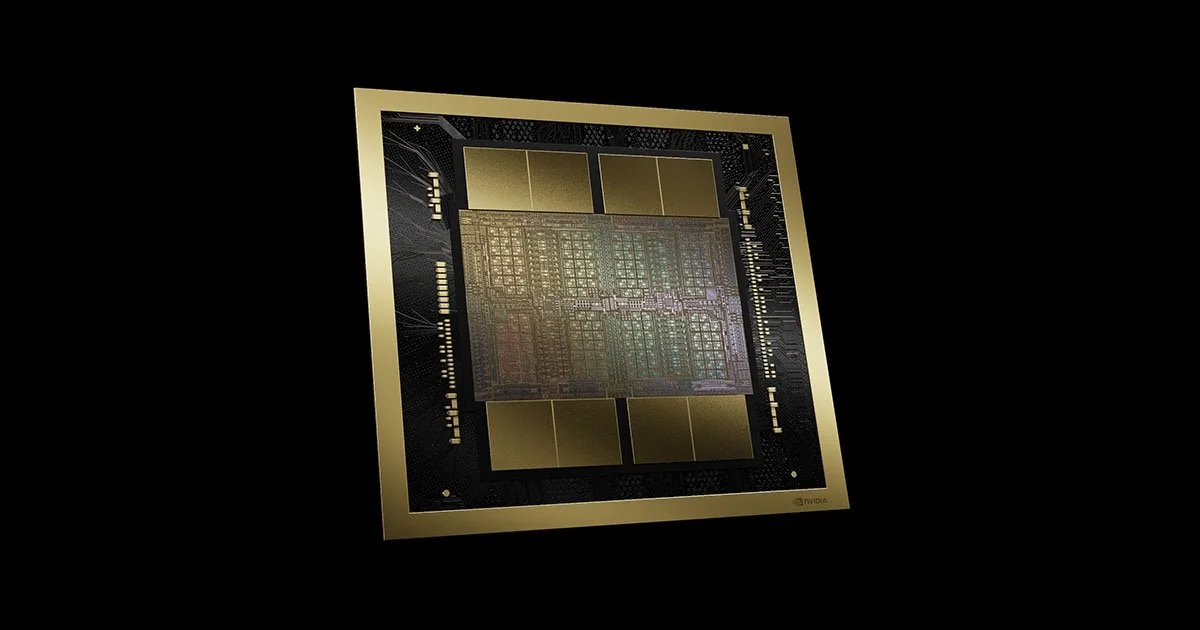

La Arquitectura NVIDIA Blackwell, presentada en su momento como el gran salto hacia la IA Generativa corporativa, logró hitos impresionantes en la inferencia de modelos de billones de parámetros. Introdujo el formato de precisión FP4, interconexiones NVLink 5 masivas y sistemas complejos a escala de rack (como el famoso GB200 NVL72).

Blackwell demostró que la industria podía ejecutar inferencias hasta 30 veces más rápido que la generación anterior (Hopper). Sin embargo, este rendimiento estratosférico trajo consigo un desafío termodinámico y financiero monumental: un rack GB200 NVL72 completo exige un suministro de más de 120 kilovatios (kW). Esto obligó a la industria a modernizar sus centros de datos de forma urgente, adoptando costosos sistemas de enfriamiento líquido directo al chip para evitar el sobrecalentamiento.

En resumen, Blackwell nos dio la potencia necesaria para masificar la inferencia, pero elevó la barra de las exigencias eléctricas al límite. Para poder escalar de manera sostenible, el mercado necesitaba algo más inteligente.

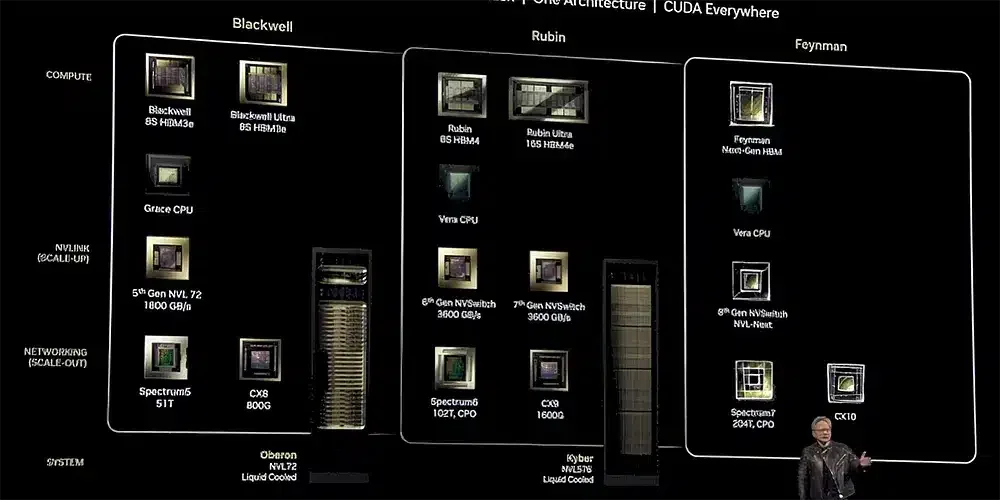

El salto a la Plataforma Vera Rubin: Eficiencia de Súper-Escala

La Plataforma NVIDIA Vera Rubin (la tan anticipada sucesora de Blackwell, consolidada en el GTC 2026) no es solo una simple actualización de litografía o de transistores; es un replanteamiento arquitectónico total de cómo interactúa el centro de datos para maximizar la producción de inteligencia.

Este nuevo "motor" ha sido diseñado específicamente para la era de la IA Agéntica, buscando maximizar la eficiencia energética en centros de datos de manera radical.

¿Cómo logra Rubin este salto cuántico para reducir los costos y dominar la inferencia?

1. Arquitectura de Súper-Escala y Fábricas de Inteligencia

NVIDIA dejó de diseñar chips aislados y pasó a concebir el ecosistema completo como una sola supercomputadora, dando paso a la era de las verdaderas fábricas de ia. La plataforma Rubin fusiona de manera hiper-eficiente el cómputo, las redes de ultra baja latencia y la memoria. Al optimizar cómo los racks completos trabajan al unísono de forma nativa, se eliminan los cuellos de botella y los desperdicios térmicos en la comunicación entre servidores, aumentando exponencialmente los Tokens por vatio (Tokens per Watt).

2. La CPU NVIDIA Vera: El orquestador de la eficiencia

Una de las grandes innovaciones es la CPU NVIDIA Vera. A diferencia de los procesadores tradicionales de propósito general, esta CPU actúa como el cerebro logístico ideal. Está optimizada para gestionar el inmenso tráfico de red y orquestar a los agentes autónomos de múltiples pasos. Al descargar las tareas pesadas de gestión de las GPUs Rubin y ejecutarlas en la CPU Vera —con una velocidad de un solo hilo muy superior— se optimiza el uso general del sistema, asegurando que la Infraestructura de IA corporativa consuma menos electricidad durante los picos de inferencia.

3. Memoria HBM4: Súper-Ancho de Banda con menor consumo

Para que los sistemas autónomos logren una correcta toma de decisiones, requieren retener "ventanas de contexto" gigantescas, recordando historiales completos de interacción. La plataforma Rubin introduce la revolucionaria memoria HBM4. Esta tecnología no solo ofrece un ancho de banda masivo para acelerar las respuestas, sino que lo hace con un perfil energético mucho más bajo. Acceder a los datos de manera más rápida e internamente eficiente reduce la dependencia del movimiento de información externa, logrando una reducción de OpEx tecnológico sustancial.

Conclusión: Transformando el TCO y asegurando el futuro

El salto evolutivo de Blackwell a Vera Rubin es el mapa de ruta definitivo que las corporaciones y los proveedores de servicios administrados deben seguir para garantizar que su evolución digital sea sostenible en el tiempo. El objetivo corporativo moderno ya no es simplemente tener la IA más rápida del mercado; es tener la plataforma con el menor costo de inferencia por cada token generado.

Al priorizar la eficiencia y entregar más Tokens por Vatio (Tokens per Watt), la Plataforma Vera Rubin otorga beneficios tangibles y estratégicos:

Mejora radical del TCO en Inteligencia Artificial (Costo Total de Propiedad): Un menor consumo eléctrico y una necesidad de refrigeración más estable se traducen en facturas mensuales mucho más bajas, optimizando el retorno de inversión desde el día uno.

Una innegable ventaja competitiva: Al reducir drásticamente el costo de cada iteración y transacción, tus modelos de IA se vuelven rentables más rápido, permitiéndote ofrecer mejores precios a tus clientes o absorber mayores márgenes de ganancia.

Cumplimiento de la Sostenibilidad ESG en TI: Operar una infraestructura de IA energéticamente más inteligente reduce de manera directa la huella de carbono de tus operaciones tecnológicas, un requisito legal y reputacional cada vez más estricto a nivel global.

En OXM TECH, somos arquitectos y consultores expertos en la modernización de infraestructura crítica y en el despliegue de centros de datos de próxima generación. Entendemos a la perfección que, para capitalizar la eficiencia prometida por plataformas como Vera Rubin, tu corporación necesita cimientos de grado empresarial: redes robustas de ultra baja latencia, arquitecturas de ciberseguridad Zero Trust y sistemas de gestión térmica avanzados.

Ayudamos a tu empresa a auditar, diseñar e implementar la arquitectura Multicloud e híbrida necesaria para que no solo seas un espectador de esta nueva revolución industrial, sino el protagonista absoluto de un negocio rentable, seguro y 100% sostenible.

🏗️ ¿Tu centro de datos está verdaderamente preparado para la era de los tokens eficientes?

No permitas que el OpEx energético y las infraestructuras legadas detengan tu adopción de la Inteligencia Artificial agéntica. En OXM TECH estamos listos para evaluar tus sistemas actuales y trazar tu ruta de modernización hacia la súper-escala.

¿Te gustaría que agendemos una sesión estratégica de arquitectura con nuestro equipo para analizar el TCO de tus proyectos de IA? ¡Hablemos!